دیپفیک به عنوان یک فناوری پیشرفته هوش مصنوعی، توانسته تصاویر و ویدیوهایی جعلی، اما واقعینما تولید کند که تشخیص آنها را دشوار کرده است. با رشد حملات سایبری و کلاهبرداری دیجیتال، این فناوری به تهدیدی جدی برای امنیت اطلاعات و هویت افراد تبدیل شده است.

خبرگزاری میزان - مطمئناً در سالهای اخیر، عکسها و فیلمهای بسیاری دیدهاید که شکی نداشتید که کاملا واقعی است، اما با جستوجوی اخبار متوجه شدید که کاملا جعلی بوده؛ این جادوی فناوری دیپفیک است.

در سالهای اخیر، عکسها و فیلمهای جعلی بسیاری از افراد مشهور با استفاده از فناوری «دیپفیک» ساخته و در فضای مجازی منتشر شده است و به دنبال آن بینندگان بدون توجه به واقعی بودن آن، فیلمها و تصاویر منتشر شده را باور کرده و از طریق اشتراکگذاری، به انتشار بیشتر آن کمک کردند.

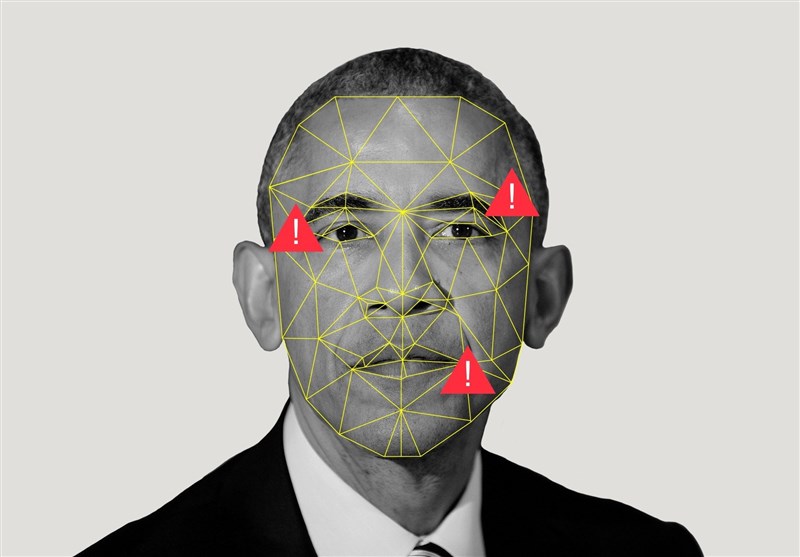

تصاویر و فیلمهایی که هیچگونه انطباقی با حقیقت ندارند، اما آنقدر واقعی است که بهسختی میتوان متوجه جعلی بودن آنها شد. بسیاری از سیاستمداران معروف همچون ترامپ و اوباما و بازیگران و سلبریتیها و مدیران مطرح دنیای فناوری مانند تیلور سوییفت و مارک زاکربرگ، همگی از افرادی بودند که در چند سال اخیر به واسطه عکسها و فیلمهای جعلی یا سخنرانیهای ساختگی، بهنوعی درگیر این فناوری دردسرساز شدهاند.

به نحوی که در فرایند برگزاری انتخابات ریاستجمهوری آمریکا، برخی شرکتهای نرمافزاری بزرگ دنیا طرحی برای انجام اقدامات جدیتری در مبارزه با اخبار جعلی و دیپفیک را در نظر گرفتند و حتی سازمان اطلاعات آمریکا (FBI) نیز طی بیانیهای درباره ویدئوهایی که با استفاده از دیپفیک ساخته شد و پیش از برگزاری انتخابات در فضای مجازی منتشر شد، هشدار داده بود.

دیپ فیک چیست؟

دیپ فیک (DeepFake) یک تکنولوژی تقریبا جدید در حوزه هوش مصنوعی است. اصطلاح «دیپ فیک» یا «جعل عمیق» از ترکیب دو واژه Deep به معنای عمیق و Fake به معنای جعلی و دروغین ساخته شده است.

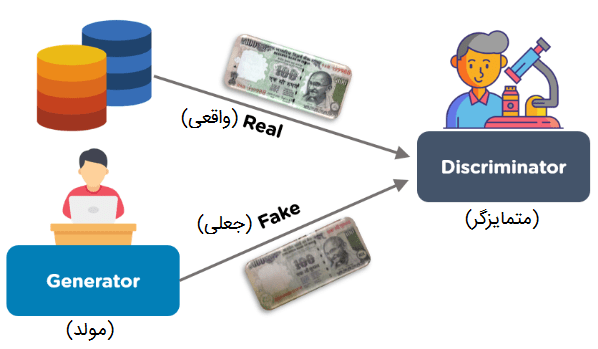

سال ۲۰۱۴ میلادی شخصی بهنام یان گودفلو (Ian Goodfellow)؛ یکی از پژوهشگران حوزه یادگیری ژرف و هوش مصنوعی، سیستم شبکه مولد تخاصمی (Generative Adversarial Network به اختصار GAN) شامل دو مدل مولد و متمایزگر را، به دنیای تکنولوژی معرفی کرد؛ شبکههای رقابتی مولد بهعنوان ابزاری در سیستمهای هوش مصنوعی برای تولید عکسها و ویدیوهای ساختگی (که در حال حاضر دیپفیک نامیده میشود)، به کار میروند.

این کشف جدید پس از سه سال، توسط فردی در ساخت یک ویدئو به کار گرفته شد و کاربری که این فناوری را در سال ۲۰۱۷، استفاده کرد نام آن ویدئو را «دیپفیک» گذاشت و ژانر جدیدی با نام «دیپفیک» خلق شد.

به این ترتیب، فناوری هوش مصنوعی مرزهای تکنولوژی را در حوزه «جعل» بسیار پیش برد و اگر در گذشته امکان داشت تنها یک عکس، توسط نرمافزارهای گرافیکی دستکاری شود و چیزی خلاف واقع یا به قول معروف فتوشاپی، به بیننده ارائه شود، امروزه فناوری خطرناکتری ایجاد شد که میتواند چهره و صدای افراد را بهطرز شگفتآوری جابه جا و یا تقلید کند و در قالب ویدیوهای باورپذیر منتشر کند.

فناوری دیپفیک میتواند بر مبنای هوش مصنوعی، تصاویر و ویدیوهای جعلی، اما «واقعینما» تولید کند و هر فردی را تحت تاثیر خود قرار دهد.

دیپ فیکها با بهرهگیری از یادگیری ژرف (Deep Learning) و حجم عظیمی از دادهها و شبکه عصبی مصنوعی ساخته میشوند و نتیجه محاسبات پیچیدهای هستند که میتوانند بهعنوان مثال از دو منبع تصویری مجزا، یک ویدیوی جعلی جدید بسازند، این دستکاری تنها به ویدیو خلاصه نمیشود و با استفاده از آن میتوان صدا را هم جعل کرد به نحوی که شخصی جملهای را در یک فیلم بگوید که هیچگاه در واقعیت نگفته است.

با وجود اینکه در سالهای اخیر، بر سواد رسانهای و توجه به «سند» و «واقعیت» برای پرهیز از فریب خوردن با محتواهای جعلی تاکید شده، اما با پیشرفت این فناوری، به نوعی سندها و فکتهای جعلی تولید شده است و این امر گاهی تشخیص حقیقت را غیرممکن کرده است که موضوعی بسیار خطرناک است.

افزایش کلاهبرداری و جرایم سایبری با استفاده از هوش مصنوعی و دیپفیک

از آنجا که مجرمان سایبری با پیشرفت راههای امنیتی در فضای دیجیتال، به تطبیق تکنیکها و روشهای خود برای یافتن راههای جدید ادامه میدهند و به دنبال کشف روشهای جدیدتری هستند، کلاهبرداری با کمک هوش مصنوعی در سطح جهانی بهطور فزایندهای در حال رشد است.

تحقیقات نشان میدهد، در سال ۲۰۴۴ برای اولین بار، جعل اسناد دیجیتال از جعل اسناد فیزیکی، بیشتر شده است و جعل دیجیتال ۵۷ درصد از کل تقلب در اسناد را به خود اختصاص داد.

طبق تحقیقات جهانی، در سال ۲۰۲۴ هر پنج دقیقه یک حمله دیپفیک اتفاق میافتد، و جعل اسناد دیجیتال ۲۴۴ درصد نسبت به سال قبل افزایش پیدا کرده است.

این تحقیقات نشاندهنده افزایش ۲۴۴ درصدی جعل اسناد دیجیتال در سال ۲۰۲۴ نسبت به سال ۲۰۲۳ و افزایش ۱۶۰۰ درصدی نسبت به سال ۲۰۲۱ است که در آن سال تقریباً تمام اسناد تقلبی جعلی، اسناد فیزیکی بودند.

با افزایش روشهای کلاهبرداری به کمک هوش مصنوعی، کلاهبرداران اکنون میتوانند از حملات پیچیدهتری در مورد اسناد، به ویژه کارتهای شناسایی (۴۰.۸ ٪ از حملات در سطح جهانی) استفاده کنند.

کلاهبرداران سایبری از پلتفرمهای «X as a service» (هر نوع سرویسی که بتوان در محیط اَبر و از هر جای دنیا و در لحظه ارائه کرد، مانند خدمات زیرساخت و نرم افزارها) برای فیشینگ، کلاهبرداری و باجافزار استفاده میکنند.

اشتراکگذاری دانش «best practices» (روال مطلوب: روش یا تکنیکی که منجر به نتایج بهتری نسبت به روشهای دیگر شده و بهدلیل اینکه بهطور عام توسط گروهی از افراد خبره یک رشته یا موضوع پذیرفته شده، بهعنوان یک شاخص استفاده میشود.) و استفاده از ابزارهای هوش مصنوعی مولد GenAI (نوعی از هوش مصنوعی که محتوای جدیدی مانند متن، تصاویر، فیلم و صدا تولید میکند) ایجاد حملات جعل دیجیتال و حملات تزریقی (Injection) پیچیده را تسهیل میکند.

در یک حمله از نوع تزریقی، مهاجم یک برنامه با ورودی مشکوک را تحت تأثیر قرار میدهد، به این صورت که مفسّر وب این ورودی را بهعنوان بخشی از یک دستور پردازش میکند و نحوه اجرای آن نرم افزار را تغییر میدهد.

حملات تزریقی، قدیمیترین و مضرترین حملات علیه برنامههای کاربردی وب هستند، این حملات ممکن است منجر به از دست دادن دادهها، از بین رفتن یکپارچگی دادهها، سرقت دادهها، انکار سرویس و به خطر افتادن کلی سیستم شود، معمولاً اصلیترین علت آسیبپذیری از طریق حملات تزریقی اعتبار سنجی ناکافی ورودی کاربران است.

افزایش کلاهبرداران آماتور و غیرسازمانیافته

هرچند از لحاظ تاریخی، بزرگترین تهدیدها از طریق حلقههای کلاهبرداری سازمانیافته بوده است. اما با توجه به تحقیقات انجام شده، احتمالاً با پیشرفت تکنولوژی در زمینه هوش مصنوعی، تعداد کلاهبرداران آماتور و مجرمان غیرسازمانیافته افزایش پیدا میکنند، که این افراد هم حجم حملات و هم تعداد حملاتی که از تکنیکهای پیچیده استفاده میکنند، را افزایش میدهند.

دیپفیک، به این دلیل مورد توجه سازمانهای جهانی قرار گرفته است، که ترفندهای کلاهبرداری در فضای مجازی مانند فیشینگ، که تشخیص آنها نسبتاً راحت است، بهسرعت جای خود را به دیپفیکهای بیش از حد واقعی و هویتهای مصنوعی تولید شده توسط هوش مصنوعی میدهد.

افزایش نرمافزارهای تعویض چهره و ابزارهای GenAI به کلاهبرداران این امکان را میدهد تا حملات کلاهبرداری بیومتریک (جعل هویت اشخاص) را بسیار باورپذیر انجام دهند. ظرفیت استفاده مخرب از این فناوری بسیار گسترده است و شامل افتتاح حسابهای تقلبی، تصاحب حساب، کلاهبرداریهای فیشینگ و کمپینهای اطلاعات نادرست میشود.

حوزههای مالی؛ هدف اصلی مجرمان

سه هدف اصلی مجرمان در سطح جهان (سال ۲۰۲۴) همگی مربوط به خدمات مالی در سه حوزه رمزارزی، بانکی و بانکهای سنتی بود، بهطوری که تلاش برای کلاهبرداری در حوزه ارزهای دیجیتال تقریباً دو برابر تعداد تلاشها در مقایسه با سایر حوزهها بود.

پلتفرمهای کریپتو (رمزارزی) بالاترین آمار در زمینه تلاش برای کلاهبرداری را به خود اختصاص دادهاند که نسبت به سال گذشته ۵۰ درصد افزایش یافته و از ۶.۴ درصد در سال ۲۰۲۳ به ۹.۵ درصد در سال ۲۰۲۴ رسیده است. این موضوع میتواند به دلیل رسیدن رمزارزها به بالاترین قیمت خود در سال ۲۰۲۴ باشد و این موضوع، فعالیت در زمینه رمزارزها را برای کلاهبرداران بسیار جذاب کرده است.

بنابراین، تغییرات بسیاری که در چشمانداز کلاهبرداری جهانی، از طریق افزایش قابل توجه حملات پیشرفته و مبتنی بر هوش مصنوعی ایجاد شده است، هشداری است که همه مدیران کسبوکارها و کاربران باید آن را جدی بگیرند.

آخرین اطلاعات و دادهها نیز بر این روند هشداردهنده تأکید میکند و نشان میدهد که کلاهبرداران چگونه به سرعت در حال تکمیل و بهبود روشها و تکنیکهای خود هستند. از آنجا که این تهدیدهای فراگیر، دولت و افراد را به طور یکسان تحت تأثیر قرار میدهند، تیمهای امنیتی برای پیش افتادن از کلاهبرداران، باید استراتژیهای خود را دائما به روزرسانی کنند و با روشهای جدید تطبیق دهند، و نظارت بر این تهدیدها را در اولویت قرار دهند و سازمانهای خود را برای رویارویی با این واقعیت جدید آماده کنند. این موضوع امری اجتنابناپذیر است که راه فراری از آن وجود ندارد.

چگونه دیپ فیک را تشخیص دهیم؟

هرچند توجه رسانهها و کاربران اینترنتی به پدیده «دیپفیک» کمرنگ شده است اما، تکنیک دیپفیک همچنان در فهرست تکنولوژیهای شگفتآور قرار دارد و پژوهشگران بسیاری در حال بهبود روشهای آن هستند.

برای کشف و جلوگیری از گسترش دیپفیک نیز باید از هوش مصنوعی کمک گرفت. در حال حاضر، راههایی وجود دارد تا یک عکس یا ویدیوی جعلی را تشخیص داد. دقت در نشانههای زیر میتواند به تشخیص یک تصویر یا ویدئوی جعلی کمک میکند:

- وجود ناهماهنگی در پوست یا موی شخص؛ مخصوصا جایی که تارهای مو در حاشیه عکس قابل مشاهده است.

- دقت به لبه صورتهای جابهجا شده؛ تکنولوژی دیپ فیک هنوز نمیتواند لبههای چهره را بدون نقص جابهجا کند و در طول یک ویدیو، هنگام حرکت سر سوژه، احتمال زیادی دارد که بشود دیپ فیک را تشخیص داد.

- دقت در نورپردازی تصویر؛ جواهرات و دندانهایی که بازسازی بدی دارند و افکتهای نورپردازی عجیبی مانند انعکاس نور در چشم، میتواند دیپفیک را لو دهد.

- دقت به نور عکس یا فیلم؛ اکثر الگوریتمهای دیپفیک نور فیلمی را که بهعنوان مدل برای فیلم جعلی مورد استفاده قرار گرفته حفظ میکند، که با نورپردازی در ویدیوی هدف مطابقت ندارد.

- عدم تطابق صدای ویدیو با حرکات دهان شخص؛ مخصوصا اگر صدای اصلی فیلم جعلی با دقت دستکاری و تنظیم نشده باشد.