انسیه کنی نژاد مقدم - دسترسی راحت و سریع به اینترنت که رویای گذشته بود، اکنون ممکن شده اما حجم بالای اطلاعات، آرامش ذهنی افراد را بر هم زده به طوری که فناوری دیجیتال را همانند یک سم مهلک به زندگی وارد کرده است. سم شیرینی که گاهی اعتیادآور است و رهایی از آن چه بسیا از ترک مواد افیونی سختتر.

ایرنا- امروزه اینترنت همه جا هست؛ در صعب العبورترین مناطق کوهستانی تا قطب شمال و جنوب و حتی بیابان های بی آب و علف می توان با داشتن تجهیزات به دنیای اینترنت پا گذشت و از گذشت و گذارهای اینترنتی لذت برد.

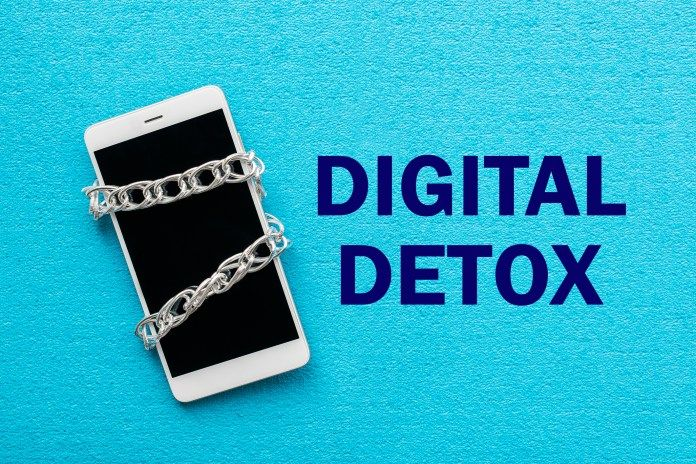

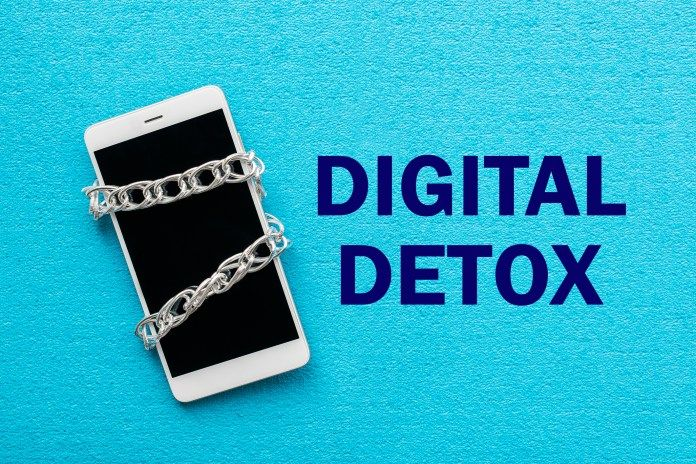

حقیقت این است که با گسترش گوشیهای همراه، اینترنت همراه، شبکههای اجتماعی مانند؛ اینستاگرام، توییتر، لینکدین، واتساپ، روبیکا و هزار برنامه رنگارنگ و جذاب دیگر زندگی متفاوت شده است؛ دسترسی راحت و سریع به اینترنت که رویای گذشته بود ممکن شده اما حجم بالای اطلاعات، آرامش ذهنی افراد را بر هم زده و فناوری دیجیتال را همانند یک سم مهلک به زندگی وارد کرده است. سم شیرینی که گاهی اعتیادآور است و رهایی از آن چه بسیا از ترک مواد افیونی سختتر. در این شرایط موضوعی بنام دیجیتالدیتاکس یا سمزدایی اینترنتی مطرح شده است.

در این مقاله با ما همراه باشید تا چنانچه احساس میکنید شما نیز با مشکلات استفاده از دنیای دیجیتال مواجه هستید، به سمزدایی اینترنتی روی آورید.

دیجیتال دیتاکس یا سم زدایی اینترنتی چیست؟

غرق شدن در دنیای دیجیتال جزئی جدایی ناپذیر از زندگی بسیاری از افراد شده است. این امر موجب شده، مغز انسان محلی برای انباشت اطلاعات پراکنده و گاها زاید شده و فرد را از تعامل با دنیای واقعی و لذت بردن از زندگی روزمره باز داشته و به شکل یک اعتیاد رفتاری در افراد یا بهم ریختگی تعاملی برای مشکلات جسمی، فیزیولوژیکی و مشکلات اجتماعی خود را نشان دهد.

در این شرایط که دورشدن از فضای دیجیتال، نه راهحل صحیح برای داشتن زندگی آرام است و نه ممکن، چه باید کرد؟ اینجا بود که راهحلی به نام دیجیتال دیتاکس (Digital Detox) یا سم زدایی اینترنتی مطرح شد.

دیتاکس به معنی دفع سموم از بدن است. سم زدایی اینترنتی به مدت زمانی گفته میشود که فرد از استفادهی دستگاههای فناوری مانند؛ گوشیهای هوشمند، تلویزیون، رایانه، تبلت و سایتهای رسانههای اجتماعی خودداری کند. این کار اغلب به عنوان راهی برای تمرکز بر تعاملات اجتماعی واقعی بدون حواس پرتی در نظر گرفته میشود. با کنار گذاشتن دستگاههای دیجیتال، حداقل به طور موقت، افراد میتوانند استرس ناشی از اتصال مداوم را رها کنند.

اگر لازمه شغل شما استفاده از اینترنت و چک کردن ایمیل و برنامههای اجتماعی است، نگران نباشید سم زدایی دیجیتالی برای شما مقدور است. چرا که این برنامه که معمولا در یک بازه ۳۰ روزه صورت میگیرد، استفاده از اینترنت را در ساعات اداری و امورات شغلی بلا اشکال میداند.

قبل از اینکه تصمیم بگیرید که آیا شما به سم زدایی اینترنتی نیازدارید یا خیر، ابتدا با دلایل مورد نیاز به سمزدایی و راههای آن آشنا شوید.

دلایل نیاز به سمزدایی دیجیتال

برای بسیاری از مردم، ارتباط و غوطهور شدن در دنیای دیجیتال را تنها بخشی از زندگی روزمره خود میدانند در حالی که برخی دیگر بخش عمدهای از ساعات شبانهروز خود را صرف گوش دادن، تماشا کردن، خواندن- یا تعامل با رسانهها میکند.

دلایل زیادی وجود دارد که بخواهید تلفن همراه و سایر دستگاههای خود را برای مدت کوتاهی کنار بگذارید. ممکن است بخواهید بدون تداخلی که تلفن و سایر دستگاهها ایجاد میکنند، از وقت خود لذت ببرید. در موارد دیگر، ممکن است احساس کنید استفاده از دنیای دیجیتال در شما بیش از حد شده و استرس زیادی به زندگی شما اضافه میکند.

در برخی شرایط، حتی ممکن است احساس کنید که به دستگاههای خود معتاد شدهاید. در حالی که اعتیاد به فناوری به طور رسمی به عنوان یک اختلال شناخته نمیشود، بسیاری از کارشناسان معتقدند که استفاده بیش از حد از فناوری، نشان دهنده یک اعتیاد رفتاری بسیار واقعی است که میتواند منجر به مشکلات جسمی، روانی و اجتماعی شود. لذا با یک جمع بندی از تحقیقات صورت گرفته دنیای دیجیتال میتواند مشکلات زیر را ببار آورد:

- دنیای دیجیتال میتواند استرس زا باشد

استفاده از فناوریهای دیجیتال و اینترنت و نیاز به استفاده دائمی به بررسی ایمیلها، متنها و رسانههای اجتماعی بیشترین استرس فنی را به فرد وارد کرده و در نتیجه مشکلات خواب، علائم افسردگی و افزایش سطح استرس را بههمراه دارد.

- فناوریهای دیجیتال خواب را مختل میکنند

استفاده طولانی مدت از اینترنت و فناوریهای دیجیتال، به ویژه قبل از خواب، میتواند در کیفیت و کمیت خواب اختلال ایجاد کرده و اثرات نامطلوبی بر خواب و خلق و خوی فرد وارد آورد.

- فناوریهای دیجیتال و تاثیر منفی بر مغز

استفاده از فناوریهای دیجیتال با نگرانیهای مربوط به سلامت روان مرتبط است و خطر ابتلا به مشکلات سلامت روان بخصوص در میان نوجوانان را افزایش میدهد.

- افزایش مقایسه خود با دیگران

در این مقایسه ممکن است، فکر کنید دیگران زندگی کاملتر، غنیتر یا هیجانانگیزتری دارند. سم زدایی از ارتباطات اینترنتی میتواند راه خوبی برای تمرکز بر آنچه در زندگی شما مهم است بدون مقایسه خود با دیگران باشد.

- استرس عقب ماندن از دیگران

مقایسه زندگی خود و دیگران ممکن است ترس از دست دادن فرصتها که به نام FOMO شناخته میشود را در شما ایجاد کند. سمزداییدیجیتال یکی از راههای محدودیت و کاهش ترس از دست دادن فرصتها است.

- ازدسترفتن رضایت از زندگی با دیدن زندگیهای تجملاتی واقعی و بعضا غیر واقعی در دنیای مجازی

- فراموشکردن هویت واقعی با حضور طولانی مدت در شبکههای اجتمای و فراموش کردن علایق خود

- ورود اطلاعات زیاد و برهمزدن آرامش درونی با بدست آوردن اطلاعات متفرقه و غیر مفید

- کاهش توانایی ارتباط مؤثر با دیگران، ارتباط در فضای مجازی امکان پوشاندن ضعفهای شخصی و نمایش خودمان به دیگران، آنطور که مورد پسند دیگران است فراهم شده است و بهجای صرف زمان برای بهبود ضعفهای شخصیتی و پذیرش دیگران، آنطور که هستند، به دنبال دوستانی ایدهال در فضای مجازی هستیم.

نشانههای نیاز به سمزدایی دیجیتال

چنانچه بیش از دو مورد از نشانههای زیر را دارید به شما پیشنهاد میکنیم حتما برای یکبار هم شده دوره سمزدایی دیجیتال را امتحان کنید.

• اضطراب و استرس در صورت پیدا نکردن تلفن همراه یا عدم دسترسی به اینترنت

• چک کردن تلفن همراه هر چند دقیقه یکبار

• احساس افسردگی، اضطراب یا عصبانیت پس از گذراندن وقت در شبکههای اجتماعی

• درگیری تعداد لایک، کامنت یا اشتراکگذاری مجدد در پستهای اجتماعی

• ترس از دست دادن نکات و اخبار جدید در صورت بررسی نکردن تلفن همراه

• تا دیروقت بیدار ماندن یا زود بیدار شدن برای چک کردن اینترنت یا بازی با آن

• عدم تمرکز بر روی مسائل مختلف بدون نیاز از اینترنت و گوشی همراه

حال که با سمزدایی اینترنتی آشنا شدید و علائم اعتیاد به اینترنت و فناوریهای دیجیتال را شناختید میخواهیم شما را راهنمایی کنیم که چگونه میتوانید سمزدایی اینترنتی را انجام دهید.

چگونگی سمزدایی دیجیتال

خیره شدن به دستگاههای دیجیتال در حال حاضر لذتبخش است، اما رفتارهای لذتبخش اعتیادآور هستند و هزینه بسیاری برای روح و روان افراد ببار میآورند. لذا با سمزدایی دیجیتال شما میتوانید تعامل خود با دنیای دیجیتال را کنترل کرده و به شکل سالم درآورید و بجای اینکه در خدمت فناوری باشد، فناوری را در خدمت خود داشته باشید. راهکارهای زیر میتواند شما را در این راه کمک کند:

اعلانها را خاموش کنید: با خاموش کردن اعلانها میتوانید توجه خود را از گوشی خود پرت کرده و کمتر به سراغ آن بروید.

سیاه و سفید کردن صفحه گوشی: یکی از دلایل جذابیت اینترنت و دنیای دیجیتال پر زرق و برق بودن آن است. لذا به شما پیشنهاد میکنیم تنظیمات گوشی خود را در حالت خاکستری قرار دهید.

گوشی خود را هنگام صرف غذا کنار بگذارید: با قرار دادن گوشی در کنار میز غذا تمام مدت به دنبال یک خبر و اطلاعات جدید در دنیای دیجیتال هستید و نمیتوانید از غذا خوردن خود لذت ببرید.

ساعات کاری بدون فناوری تعیین کنید: با تعیین زمان مشخص برای استفاده از فناوری دیجیتال میتوانید معجزه خوشحالی و سرزندگی را در خود ببینید.

ممنوعیت ورود فناوری به اتاق خواب: تخت خود را به منطقهای عاری از وسایل دیجیتال تبدیل کنید و فرصتهای بیشتری را برای صمیمیت و رابطه با شریک زندگی خود بدست آورید.

با کتابهای کاغذی آشتی کنید: نه تنها کتابها حواسپرتی کمتری ایجاد میکنند، بلکه مطالعه آنها، کارآمدتر و آگاهتر از خواندن روی صفحه نمایش است. علاوه بر این بهتر است، اخبار خود را از یک روزنامه دریافت کنید.

مراجعه خود به فضای دیجیتال را به یک صفحه محدود کنید: عادت کنید هر بار فقط به یک صفحه نمایش نگاه کنید تا بتوانید تمرکز خود را حفظ کنید و حواستان با مطالب صفحات دیگر پرت نشود.

حسابهای رسانهای اجتماعی خود را پاک کنید: با پاککردن حسابهای رسانهای خود از ارتباط واقعی با دوستان خود لذت ببرید. علاوه بر این با پاککردن حسابهایی که به شما حس بدی منتقل میکنند، عزت نفس خود را حفظ کنید و از اجتماعی بودن خود کمال استفاده را داشته باشید.

از برنامههای مناسب استفاده کنید: با مسدود هر برنامهای که حواستان را پرت میکند، حواستان را متمرکز کنید و تماسها، پیامکها و اعلانهای مورد نیاز را انتخاب و سایر را مسدود کنید.

از بدن خود محافظت کنید: استفاده طولانی از فناوری دیجیتال باعث ایجاد فشار چشم دیجیتال شده و خشکی چشم و تاری دید و سردرد را به همراه دارد. علاوه بر این تایپ طولانی علاوه بر ایجاد گردن درد موجب ایجاد درد در شصت درد نیز میشود.

روبان رنگی به دور گوشی خود ببندید: تا با دیدن آن روبان تصمیم خود در سمزدایی را بیاد آورید.

قفل گوشی خود را تغییر دهید: تا به راحتی سراغ گوشی خود نروید و برای رفع احساس تنهایی یا بیحوصلگی راه دیگری بیابید.

زمان خود را همانند پول ارزشمند بدانید: به خاطر داشته باشید، پول قابل برگشت و جایگزینی است، اما ازدسترفتن زمان و توجه ما قابل جبران نیست. پس در خرجکردن آن توجه بیشتری داشته باشید.

چند ایده خوب برای سم زدایی دیجیتال

- روزه دیجیتالی: سعی کنید تمام دستگاههای دیجیتال را برای مدت کوتاهی مانند یک روز یا حداکثر یک هفته کنار بگذارید

- پرهیز مکرر دیجیتال: یک روز از هفته را انتخاب کنید تا بدون استفاده از دستگاه استفاده کنید.

- سمزدایی خاص: اگر یک برنامه، سایت، بازی یا ابزار دیجیتالی بیش از حد وقت شما را می گیرد، روی محدود کردن استفاده از آن مورد مشکل ساز تمرکز کنید.

- سمزدایی از رسانههای اجتماعی: روی محدود کردن یا حتی حذف کامل استفاده از رسانههای اجتماعی برای یک دوره زمانی خاص تمرکز کنید.

- به دوستان و خانواده خود اطلاع دهید که در یک سمزدایی دیجیتال هستید و از آنها کمک و حمایت بخواهید.

- راههایی بیابید که حواس خود را پرت نگه دارید و فعالیتهای دیگر را در دسترس داشته باشید.

- برای کاهش وسوسه و دسترسی آسان، برنامههای رسانههای اجتماعی را از گوشی خود حذف کنید.

- سعی کنید از خانه خارج شوید، وقتی وسوسه میشوید از دستگاه خود استفاده کنید، با دوستان خود به شام بروید یا پیادهروی کنید.

- یک دفتر خاطرات داشته باشید تا پیشرفت خود را پیگیری کنید و افکار خود را در مورد تجربه یادداشت کنید.

سخن پایانی

محدودکردن استفاده از رسانههای اجتماعی میتواند به طور قابل توجهی رفاه را بهبود بخشیده و علائم تنهایی و افسردگی را کاهش دهد. پس مراقب سموم وارده از دنیای دیجیتال باشید و سلامت روح و ذهن و بدن خود را با این دنیای مجازی به خطر نیاندازید. هر از چندگاهی حتی برای زمان کوتاهی سمزدایی دیجیتال داشته باشید تا متوجه ارزشمند بودن خود شوید.