حضور قابل توجه شرکتهای هوش مصنوعی (AI) در نشست داووس ۲۰۲۴ نشاندهنده تغییر نسبت به سالهای گذشته است.

به گزارش مشرق، پنجاه وچهارمین اجلاس سالانه مجمع جهانی اقتصاد که با شعار «بازسازی اعتماد» از روز ۱۵ ژانویه با حضور رهبران جهان، سیاستمداران و متخصصان حوزه آیتی و صنایع دیگر در داووس سوئیس برگزار شد، روز جمعه (۲۹ دی) به کار خود پایان داد. امسال مجمع جهانی اقتصاد ۲۰۲۴ بر آینده هوش مصنوعی و تغییرات آب و هوایی متمرکز بود و البته موضوع ناآرامیها و جنگهای جهانی هم مورد بحث و بررسی قرار گرفت.

تمرکز بر فناوریهای دیجیتال

در نشست سالانه ۲۰۲۴ WEF بر نقش کلیدی هوش مصنوعی و فناوریهای دیجیتال تمرکز ویژه وجود داشت و به مواردی همچون دستیابی به امنیت سایبری و همکاری در جهان، افزایش اشتغالزایی و استفاده از هوش مصنوعی به عنوان نیروی محرکه اقتصاد توجه شد.

شرکتکنندگان در این اجلاس همچنین به دنبال یک استراتژی بلندمدت برای مقابله با گرمایش کره زمین با توسعه یک رویکرد سیستمی برای رسیدن به جهانی بدون کربن تا سال ۲۰۵۰ بودند. شرکتکنندگان در این اجلاس همچنین به بررسی تعادل بین نوآوریهای فناورانه و خطرات اجتماعی آنها بویژه در زمینه هوش مصنوعی و سایر فناوریهای تحولآفرین مانند ۵G، ۶G، محاسبات کوانتومی و بیوتکنولوژی پرداختند.

گفتنی است مجمع جهانی اقتصاد یک سازمان بینالمللی است که متعهد به بهبود وضعیت جهان از طریق مشارکت دادن رهبران تجاری، سیاسی، دانشگاهی و دیگر افراد جامعه برای تحقق برنامههای جهانی، منطقهای و صنعتی است.

نبود یک استراتژی مشخص

حضور قابل توجه شرکتهای هوش مصنوعی (AI) در نشست داووس ۲۰۲۴ نشاندهنده تغییر نسبت به سالهای گذشته است که شرکتهای ارزهای دیجیتال در کانون توجه بودند.

یکی ازموضوعهای جنجالی، تأثیر هوش مصنوعی بر اشتغال است. درحالی که کریستالینا جورجیوا، رئیس صندوق بینالمللی پول نسبت به استفاده بی محابا از هوش مصنوعی هشدار داد و آن را زمینه ساز تهدید ۴۰ درصد از مشاغل موجود در جهان عنوان کرد، آنتونیو گوترش رئیس سازمان ملل هم گفت: شرکتهای بزرگ فناوری بی پروا به دنبال سود بردن از هوش مصنوعی هستند و جامعه بینالمللی هیچ استراتژی مشخصی برای مقابله با خطرات آن ندارد درحالی که این خطرات به سرعت در حال رشد است.

وی یادآورشد: هر پیشرفتی در هوش مصنوعی مولد، خطر عواقب ناخواسته را افزایش میدهد که بخشی از آن با مشکلات ناشی از بحران آب و هوا مرتبط است.

گوترش افزود: هرچند این فناوری پتانسیل عظیمی برای توسعه پایدار دارد اما احتمال بدتر شدن نابرابری موجود در جامعه جهانی وجود دارد. شرکتهای فناوری قدرتمند با بیتوجهی به حقوق بشر، حریم خصوصی و تأثیر اجتماعی آن، تنها به دنبال کسب سود هستند. این درحالی است که ما برای توسعه فعلی هوش مصنوعی و افزایش دسترسی به این فناوری در گوشه و کنار جهان و همچنین نظارت و کاهش آسیبهای آینده، نیازمند همکاری دولتها هستیم.

ما باید به جای تعمیق شکاف دیجیتالی، آن را پر کنیم. گوترش همچنین یادآورشد: حذف تدریجی سوختهای فسیلی ضروری و اجتنابناپذیر است و باید از هم اکنون برای اطمینان از انتقال عادلانه به انرژیهای تجدیدپذیر اقدام کنیم.

ضرورت آموزش و افزایش مهارت

رئیس صندوق بینالمللی پول هم در گزارشی ضمن ابراز نگرانی از تأثیر هوش مصنوعی بر اشتغال جوامع، عنوان کرد: این فناوری عمدتاً بر اشتغال کارگران یقه سفید(کارمندان اداری که غالبا تحصیلات بالاتری دارند) تأثیر خواهد گذاشت وازسوی دیگر نابرابری در بازارهای نوظهور و کشورهای کم درآمد را بیشتر خواهد کرد. در حالی که برخی از مشاغل ممکن است از افزایش بهرهوری ایجاد شده توسط هوش مصنوعی بهرهمند شوند، برخی دیگر ممکن است کاهش تقاضا و دستمزد کمتر را تجربه کنند.

جورجیوا اضافه کرد که بسیاری از کشورها فاقد زیرساختهای لازم و نیروی کار ماهر برای استفاده کامل از مزایای هوش مصنوعی هستند که این موضوع به طور بالقوه نابرابری را تشدید میکند. وی آموزش و افزایش مهارت کارکنان در جوامع فقیرتر را تنها راهکار توزیع عادلانهتر مزایای هوش مصنوعی در جهان دانست.

خوشبینی به آینده هوش مصنوعی

ساتیا نادلا مدیرعامل مایکروسافت هم در مجمع جهانی اقتصاد گفت که نسبت به آینده هوش مصنوعی، امیدوار و خوشبین است.

وی یادآورشد: به عنوان یک صنعت فناوری دیجیتال، بزرگترین درسی که آموختهایم، این است که باید عواقب ناخواسته هر فناوری جدید را همراه با تمام مزایای آن بپذیریم. ما باید به طور همزمان در مورد آنها فکر کنیم نه اینکه منتظر باشیم تا این عواقب ظاهر شوند و سپس به آنها رسیدگی کنیم.

اگرچه هوش مصنوعی پتانسیل افزایش بهرهوری، ایجاد مشاغل احتمالاً بهتر، آموزش بهتر و درمان سریعتر بیماریها را دارد، اما همچنین نگرانیهایی درباره افزایش بیکاری و گمراه کردن مردم ایجاد کرده است. گفتنی است سال گذشته مایکروسافت یک سرمایهگذاری چند میلیارد دلاری در OpenAI، شرکتی که پشت چت جی پی تی قرار دارد، انجام داد و از آن زمان این فناوری را در مجموعه محصولات خود عرضه کرده است. البته غولهای فناوری دیگر ازجمله گوگل، آمازون و متا نیز برای استقرار فناوریهای مشابه رقابت میکنند.

بهداشت، کلید حیاتی مقابله با تغییرات آب و هوایی

بیل گیتس، از بنیانگذاران شرکت مایکروسافت هم در داووس ۲۰۲۴ از تغییر و تحول زندگی بشر در ۵ سال آینده با استفاده از قدرت هوش مصنوعی خبر داد. وی یادآورشد: ظهور هوش مصنوعی این ترس را برانگیخته است که این فناوری میلیونها شغل را در سراسر جهان از بین میبرد.

هرچند لزوماً با این مفهوم مخالف نیستم، اما تاریخ نشان میدهد که با هر فناوری جدید، ابتدا ترس و سپس فرصتهای جدید به وجود میآید. به نظرم هوش مصنوعی زندگی همه را آسانتر میکند و بویژه به پزشکان کمک شایان توجهی خواهد کرد. هوش مصنوعی میتواند باعث افزایش بهرهوری شود. به اعتقاد وی، این فناوری باعث بهبود بهرهوری ۴۰ تا ۵۰ درصدی برنامهنویسان میشود تا سریعتر یک برنامه را توسعه دهند که خود تأثیر شگرفی بر زندگی بشر خواهد داشت.

وی در این رویداد همچنین هزینه کردن برای بهداشت را کلید حیاتی برای مبارزه با تغییرات آب و هوایی دانست و افزود: اگر میخواهید به تأثیر آب و هوا اهمیت دهید، باید بودجههای سلامت را افزایش دهید. وی در همین راستا اعلام کرد: بنیاد بیل و ملیندا گیتس قصد دارد در سال ۲۰۲۴، حدود ۸.۶ میلیارد دلار برای فناوری و برنامههای مراقبتهای بهداشتی هزینه کند که بزرگترین بودجه برای این سازمان غیرانتفاعی تاکنون محسوب میشود.

توسعه واکسنهای جدید و منابع ارزان قیمت برای مهار مالاریا، فلج اطفال و مرگ و میر مادران از برنامههای این بنیاد است. وی همچنین از کشورها خواست ۰.۷ درصد از تولید ناخالص داخلی خود را صرف چنین هدفی کنند چراکه هزینههای بهداشتی، نه تنها فواید بشردوستانه دارد، بلکه به دستاوردهای اقتصادی و زیست محیطی نیز منجر میشود.

بیل گیتس افزود: ما جهان را سالم میکنیم و رشد جمعیت به یک وضعیت ثابت میرسد. بر اساس شاخص میلیاردرهای بلومبرگ، بیل گیتس ۱۴۰ میلیارد دلار ثروت دارد که او را به چهارمین فرد ثروتمند روی زمین تبدیل میکند. اما اگر متعهد به بخشش تمام پولش نبود، احتمالاً همچنان ثروتمندترین فرد جهان بود.

تأمین امنیت سایبری با هوش مصنوعی

در اجلاس داووس امسال، امنیت سایبری هم در میان ۵ خطر بزرگ دنیا در دوسال آینده رتبهبندی شد که البته جای تعجب ندارد که جنگهای سایبری هم به یک موضوع نگرانکننده تبدیل شود.

برنارد مونتل، استراتژیست امنیت سایبری در این باره گفت: پذیرش گسترده رایانش ابری، سطوح جدیدی از آسیبپذیری و پیچیدگی مدیریت را معرفی میکند که میتواند توسط بازیگران بد هدف قرار گیرد. البته یک راهکار مناسب برای مقابله با این بازیگران وجود دارد و آن هم بهرهبرداری از قابلیتهای هوش مصنوعی است.

وی افزود: این فناوری، نقش مهمی در دفاع سایبری دارد و متخصصان امنیت سایبری میتوانند از آن برای جست وجوی الگوها استفاده کنند و تصمیم بگیرند که چه اقداماتی برای کاهش خطر سایبری انجام دهند. هوش مصنوعی همچنین میتواند برای تقویت راهکارهای امنیتی پیشگیرانه استفاده شود تا مدافعان از هکرها جلوتر باشند و مانع حملات موفقیتآمیز آنها شوند.

درواقع استفاده از قدرت هوش مصنوعی تیمهای امنیتی را قادر میسازد تا با تجزیه و تحلیل سریعتر، درنهایت سریعتر تصمیم بگیرند.

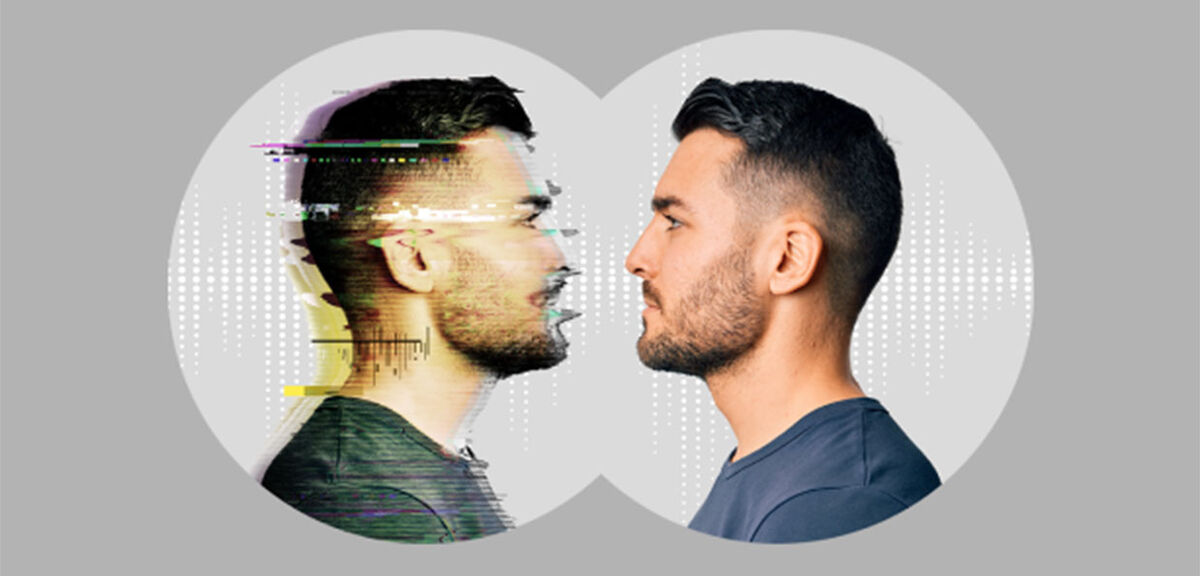

اطلاعات گمراهکننده در بزرگترین سال انتخابات

یکی دیگر از موارد مرتبط با فناوری که در اجلاس امسال مورد بررسی قرار گرفت، اطلاعات غلط و گمراه کننده (disinformation) مبتنی بر هوش مصنوعی بود که به عنوان بزرگترین تهدید کوتاه مدت شناخته و عنوان شد که چنین اطلاعاتی ممکن است فرایندهای انتخاباتی را در چندین اقتصاد در دو سال آینده به طور اساسی مختل کند. این اطلاعات، عمدتاً با قصد و نیت قبلی نوشته شده و با اهداف خاصی ازجمله منحرفکردن افکار عمومی، بهدستآوردن سود مالی و ایجاد آسیبهای اجتماعی منتشر میشوند و شامل نوشتهها تا تصاویر و ویدیوها هستند.

در این اجلاس عنوان شد: حدود ۷۰ کشور ازجمله پرجمعیتترین کشورهای جهان با مجموع بیش از ۳.۷ میلیارد نفر یا تقریباً نیمی از جمعیت جهان، در نظر دارند انتخابات ریاست جمهوری یا قانونگذاری را در سال ۲۰۲۴ برگزار کنند. با توجه به این اینکه قرار است در سال ۲۰۲۴ در کشورهایی همچون آفریقای جنوبی، امریکا، بریتانیا، هند، اندونزی، بنگلادش و روسیه انتخابات برگزار شود، این سال را بزرگترین سال انتخابات در تاریخ نامیدهاند.

درحالی امسال در اجلاس داووس، اطلاعات گمراهکننده در صدر اخبار و نگرانیها قرار گرفت که در دوره قبلی حتی درمیان ۱۰ تهدید بزرگ، چه در کوتاهمدت (دو سال آینده) و چه در بلندمدت (۱۰ سال) گنجانده نشده بود. امسال، WEF این اخبار را به عنوان بزرگترین خطر کوتاهمدت و پنجمین خطر بزرگ درازمدت پس از تهدیدهای مختلف مرتبط با تغییرات آب و هوایی رتبهبندی کرد.

در این اجلاس عنوان شد که اطلاعات گمراهکننده میتواند انتخابات و سلامت جهانی دموکراسی را تهدید کند. در این اجلاس عنوان شد در امریکا، جایی که انتخابات ریاست جمهوری در ماه نوامبر برگزار میشود، دونالد ترامپ، نامزد انتخاباتی، سابقه اثبات شدهای در انتشار اطلاعات نادرست در مورد تقلب در رأیدهندگان در انتخابات ۲۰۲۰ دارد. درواقع چنین تاکتیکهایی به قدمت خود سیاست هستند، اما امروز وضعیت بدتر از گذشته شده است.

در این اجلاس عنوان شد که پلتفرمهای بزرگ و رسانههای اجتماعی باید با ارائه راهکارهایی، از انتشار چنین محتواهایی، ممانعت کنند. هرچند در مقابل، برخی معتقدند اجازه دادن به این غولهای فناوری خصوصی برای مسدود کردن بیشتر محتوا میتواند آزادی بیان را کاهش دهد.