کشور ژاپن با توسعه پلتفرمهای بومی و قوانین سختگیرانه، استقلال دیجیتال خود را حفظ کرده و با اخبار جعلی در شبکههای اجتماعی مقابله میکند.

شبکههای اجتماعی در جهان امروز نهتنها بستر تعاملات اجتماعی و اقتصادی هستند، بلکه نقش تعیینکنندهای در حکمرانی داده، شکلدهی به افکار عمومی، جهتدهی به اقتصاد دیجیتال و تقویت قدرت نرم کشورها ایفا میکنند.

به گزارش پایگاه اطلاعرسانی مرکز ملی فضای مجازی، از اینرو، توانمندسازی در حوزه پلتفرمداری و شکلدهی به زیستبوم بومی این حوزه، به یکی از ارکان راهبردی حکمرانی فضای مجازی تبدیل شده است. کشورهایی که از قدرت ساخت، توسعه و تنظیمگری پلتفرمهای بومی برخوردارند، نهتنها در برابر سلطه پلتفرمهای فراملی آسیبپذیر نیستند، بلکه میتوانند سهم مؤثری در اقتصاد و امنیت فضای مجازی جهانی داشته باشند.

نگاهی به مجمعالجزایر ژاپن

کشور ژاپن بعنوان شرقیترین سرزمین قاره آسیا با ۱۲۳ میلیون نفر جمعیت، یکی از پیشرفتهترین اقتصادهای جهان و اولین کشور صنعتی در آسیا با زیرساختهای قوی فناوری است که توانسته یکی از قدرتهای اقتصاد دیجیتال جهان باشد.

اولین اتصال اینترنت در ژاپن به سال ۱۹۸۴ برمی گردد و در این زمینه جزو کشورهای پیشرو به شمار میآید؛ بعد از گذشت ۴ دهه، اکنون تعداد کاربران اینترنت در این قدرت آسیایی در آغاز سال ۲۰۲۵، ۱۰۹ میلیون نفر (۸۸.۲) درصد کل جمعیت بود.

ژاپن در ژانویه ۲۰۲۵، ۹۷ میلیون هویت کاربری رسانههای اجتماعی داشت که معادل ۷۸.۶ درصد از کل جمعیت این کشور است.

این کشور در کنار توسعه زیرساخت ها، در زمینه نرم افزاری و توسعه شبکههای اجتماعی بومی هم جزو کشورهایی است که توانسته تاحدودی استقلال خود را حفظ کند؛ شبکههای بومی در ژاپن به دلیل پشتیبانی داخلی و تضمین حریم خصوصی دادهها مورد استقبال قرار گرفتهاند.

کاربران ژاپنی اغلب پلتفرمهایی را ترجیح میدهند که به طور خاص نیازهای آنها را برآورده میکند و ویژگیهای مرتبط با فرهنگ آنها را دارد. همچنین دادهها و تنظیمات حریم خصوصی مدیریت شده در داخل کشور، به ویژه در شرایطی که تهدیدات امنیت سایبری بسیار بالا است، به کاربران آرامش خاطر را ارائه میدهد. اینها عمده دلایلی است که موجب شده تا ژاپنیها به سمت شبکه اجتماعی داخلی روی بیاورند.

از اولین گامهای ژاپن در زمینه شبکههای اجتماعی و پیام رسان بومی، راه اندازی «یاهو! ژاپن» بود که در سال ۱۹۹۶ از مشارکت شرکتهای سافتبانک ژاپن و یاهوی آمریکا تأسیس شد و خدمات متنوع یاهو مثل موتور جستوجو، اخبار، پیشبینی آبوهوا، خدمات ایمیل به کاربران، خرید آنلاین کالاها و خدمات و خدمات پرداخت الکترونیکی را به ژاپنیها ارائه میدهد.

لاین؛ پادشاه شبکههای اجتماعی ژاپنی

پلتفرم لاین که ابتدا شبیه یک پیامرسان مثل واتساپ شروع به کار کرد، اکنون بسیار فراتر از یک پیام رسان در زندگی روزانه ژاپنیها نقش دارد و پس از PayPay (سیستم پرداخت الکترونیکی) دومین اپلیکیشن پردانلود در اپ استور ژاپن است.

این اپلیکیشن در ژوئن ۲۰۱۱ راهاندازی شد و توانست در سال ۲۰۱۳ به بزرگترین شبکه اجتماعی ژاپن تبدیل شود. این پلتفرم در برخی دیگر از کشورها نیز مانند اندونزی، تایوان و تایلند هم مورد استقبال قرار گرفته است.

ارقام منتشر شده در منابع تجاری لاین نشان میدهد که در اوایل سال ۲۰۲۵، ماهانه ۹۷ میلیون کاربر فعال در ژاپن دارد؛ این اعداد نشان میدهد که تعداد کاربران فعال لاین در ژاپن معادل ۷۸.۶ درصد از کل جمعیت این کشور در ابتدای سال جاری میلادی بوده است و همچنین ۸۹.۱ درصد از کاربران اینترنت ژاپن در ژانویه ۲۰۲۵ نیز کاربران فعال لاین بودهاند.

در ابتدای سال، آخرین دادههای موجود نشان میداد که ۵۲.۸ درصد از کاربران فعال لاین در ژاپن زن و ۴۷.۲ درصد مردها هستند.

لاین امروزه علاوه بر امکاناتی همچون ارسال پیام، تماس صوتی و تصویری، ایجاد گروه و شبکه اجتماعی که دارد، امکانات مختلفی همچون امکان پرداخت آنلاین، بازیهای آنلاین، خدمات تاکسی اینترنتی (line taxi)، سفارش غذا، دریافت اخبار روزانه (line today)، خدمات درمانی آنلاین، خدمات خرید اینترنتی (line shopping) و... است و کلیه نیازهای روزانه مردم ژاپن از طریق این اپلیکیشن قابل برآورده شدن است.

یکی دیگر از ویژگیهای برنامه لاین که در موفقیت آن تاثیرگذار بود، مخاطب شناسی و بهره مندی از علاقه مردم ژاپن و شرق آسیاییها به انیمه بود و با خلق کاراکترهایی جذاب ویژه این برنامه در قالب استیکرها، line freinds راه افتاده که همان شخصیتهای کارتونی این برنامه هستند و امروزه فروشگاههایی به این نام در کشورهایی مانند ژاپن، کره جنوبی، چین، تایوان، هنگ کنگ، فیلیپین، تایلند و حتی آمریکا وجود دارد.

شبکههای اجتماعی بازی محور در ژاپن

ژاپن از کشورهای مطرح دنیا در زمینه ساخت بازیهای رایانهای است و این را مدیون نوآوری و خلاقیت شرکتهای سازنده این بازیها و همچنین طرفداران این صنعت در داخل کشور است؛ تنها در سال ۲۰۲۳، ژاپن بیش از ۷۳ میلیون گیمر داشت که هر کدام به طور متوسط ۲۴۹ دلار آمریکا هزینه کردند. بازار بازی ژاپن به لحاظ تجاری بعد از آمریکا و چین در رتبه سوم و به لحاظ تعداد استفاده کنندگان در رتبه هشتم است؛ همین صنعت زمینهای شده تا شبکههای اجتماعی مخصوص گیمرها هم در ژاپن رشد و توسعه پیدا کند.

گری (GREE) یک سرویس شبکه اجتماعی ژاپنی است که در درجه اول بر بازیهای موبایلی تمرکز دارد و بیش از ۹۰ درصد کاربران آن از طریق تلفنهای همراه خود به این شبکه دسترسی دارند. این شرکت با فروش کالاهای مجازی به کاربران مانند لباس برای آواتارهای درون بازی، درآمد کسب میکند.

ویژگیهای شبکه اجتماعی گری شامل پروفایل کاربر، دفتر خاطرات، انجمنها، اشتراکگذاری عکس و ارسال ایمیل است. این سرویس به عنوان بستری برای ارتقای ارتباط و درک متقابل بین اعضای آن عمل میکند.

در حالی که گری در ابتدا فقط برای کاربران رایانه شخصی در دسترس بود، این سرویس بعداً به کاربران تلفنهای همراه نیز گسترش یافت. گری برای تلفنهای همراه شامل عملکردهای معمول شبکه اجتماعی، بازیهای اجتماعی، بازیهای مبتنی بر فلش، وبلاگها، فالگیری، اخبار و ... است. در سال ۲۰۱۰، شرکت گری، این پلتفرم را برای آیفون و اندروید راهاندازی کرد تا تقاضاهای مخاطبان را برآورده کند.

گری انواع برنامههای بازیهای اجتماعی را برای تلفنهای همراه و گوشیهای هوشمند با ارتباط پیشرفته بین کاربران ارائه میدهد. منبع درآمد عمدتاً از فروش تبلیغات و فروش خدمات پولی تشکیل شده است.

موباج (Mobage) نیز یک سکو و شبکه اجتماعی برای بازیهای متعلق به شرکت ژاپنی DeNA است. نام این شبکه اجتماعی از کلمه عامیانه ژاپنی برای بازیهای موبایل گرفته شده است.

در میان شبکههای اجتماعی بومی در ژاپن باید به «میکسی» (Mixi) هم اشاره کرد که در سال ۲۰۰۴ راهاندازی شد؛ پلتفرمی پیشگام در تاریخ رسانههای اجتماعی ژاپن که محبوبیت آن از فیسبوک و توییتر در منطقه پیشی گرفت و شبکهای محبوب برای کاربرانی بود که به دنبال تجربه رفاقت آنلاین بودند. در زمان اوج خود، میکسی روزانه ۱۵ میلیون کاربر فعال داشت، اما با تسلط پلتفرمهای جهانی بر صحنه کم کم محبوبیت آن به حاشیه رفت تا اینکه در دسامبر ۲۰۲۴ میکسی ۲ از راه رسید و چشماندازی تازه از شبکههای اجتماعی ارائه داد. در سال ۲۰۱۱، این پلتفرم به عنوان سریعترین شرکت ژاپنی از نظر رشد انتخاب شد.

قوانین ژاپن در حوزه پلتفرم داری

ژاپن همواره در تلاش است تا قوانین خود در زمینه نظارت بر پلتفرمها را توسعه دهد و خلأها را در این زمینه شناسایی کند. این کشور از سال ۲۰۰۳ اقدام به قانونگذاری در زمینه فضای مجازی کرد تا با توجه به سرعت اینترنت در این کشور، خلأهای قانونی را پر کند.

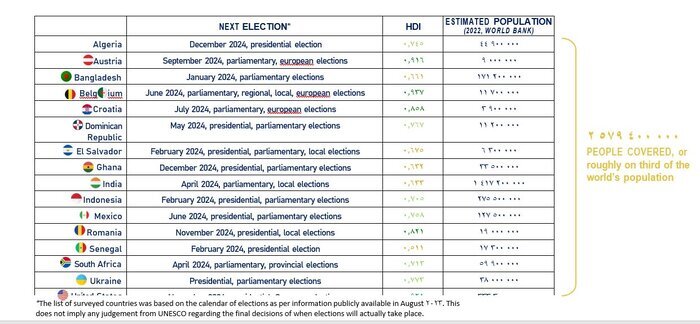

پارلمان ژاپن سال ۲۰۲۴، قانون اصلاحشدهای را تصویب کرد که غولهای رسانههای اجتماعی مانند فیسبوک و ایکس را ملزم به حذف سریع محتوای «افترا آمیز» از پلتفرمهای خود میکرد.

این قانون اصلاحشده، اپراتورهای پلتفرم رسانههای اجتماعی را موظف میکرد تا آیکونی را برای پذیرش درخواستهای حذف ایجاد کنند و معیارهای حذف پستها را در کنار سایر اقدامات، اعلام کنند. این قانون همچنین شرکتهای رسانههای اجتماعی را ملزم میکند قبل از حذف محتوای خود، به شهروندان اطلاع دهند. دولت ژاپن معتقد بود که اقدامات خودتنظیمی شرکتهای رسانههای اجتماعی در مبارزه با اطلاعات نادرست ناکافی است.

همچنین NHK (سازمان ملی رادیو تلویزیون ژاپن) با راه اندازی یک تیم رصد اجتماعی (SoLT) بر اخبار منتشر شده در شبکههای اجتماعی نظارت و محتواهای نادرست و گمراه کننده را رصد میکند؛ یک اتاق خبر کوچک که هر روز ۲۴ ساعته و ۷ روز هفته، ایکس و فیسبوک را در ژاپن از نزدیک رصد و از سال ۲۰۱۳ فعالیت خود را آغاز کرده است.

این تیم هر هفته حداقل ۲ الی ۳ مطلب منتشر میکنند که اخبار جعلی و اطلاعات نادرست را رد کرده و توضیح میدهد که چگونه با محتوای گمراهکننده در رسانههای اجتماعی برخورد شود.

تیم رصد اجتماعی به ویژه هر زمان که اخبار مربوط به بلایای طبیعی یا جرایم خیابانی در رسانههای اجتماعی منتشر میشود، مؤثر بوده است.

به عنوان مثال، پس از زلزله نوتو در ژاپن در سال ۲۰۲۴، پستهایی در رسانههای اجتماعی به دروغ ادعا کردند که این زلزله ساخته دست بشر است. کائوری ایدا، مدیر وقت بخش اخبار دیجیتال در NHK، گفت: ما تا پایان روز دوم ۲۵۰ هزار پست در مورد فرضیه زلزله مصنوعی مشاهده کردیم.

نظارت و مبارزه با چنین سیلی از اطلاعات گمراهکننده در رسانههای اجتماعی تنها بخشی از نقش این تیم است. این تیم که در دفتر مرکزی NHK در شهر شیبویا در توکیو مستقر است، شامل دانشجویان روزنامهنگاری است و در سه شیفت رسانههای اجتماعی را رصد میکند و اخبار را به زبان ژاپنی و سایر زبانها بررسی میکند.

تصمیم بر تصویب قانون فوق الذکر دقیقاً بعد از آن صورت گرفت که گزارشهای زیادی مبنی بر اخبار جعلی از حادثه زلزله نوتو در فضای مجازی منتشر میشد.

این نظارت بر رفتار شبکههای اجتماعی منحصر به پلتفرمهای خارجی نیست بلکه ژاپن نسبت به لاین هم حساسیتهایی را بروز داده است؛ دولت این کشور در مارس ۲۰۲۱ اعلام کرد که پس از گزارش رسانههای ژاپنی مبنی بر اینکه لاین به مهندسان چینی در یک شرکت وابسته به لاین در شانگهای اجازه داده است بدون اطلاع کاربران ژاپنی به دادههای آنها دسترسی پیدا کنند، در مورد این اقدام اعلام تحقیقات کرد.

NHK و سایر رسانههای محلی گزارش داده بودند که طبق مقررات حفظ حریم خصوصی ژاپن، شرکتها باید به کاربران اطلاع دهند که چه زمانی دادههای شخصی آنها به خارج از کشور ارسال میشود. سخنگوی لاین در آن زمان اعلام کرد که دسترسی به دادههای کاربران را در شرکت وابسته به چین مسدود کرده است؛ از آن پس دولت ژاپن تصمیم گرفت تا از لاین برای انتقال اطلاعات حساس موقتا استفاده نکند. دادگاههای این کشور چندبار علیه شرکتهای بزرگ فناوری ثبت شکایت کرده و آنها را به پرداخت غرامت محکوم کردند.

در ژوئن ۲۰۲۲، دولت ژاپن اعلام کرد ۴۸ شرکت فناوری از جمله توییتر، متا پلتفرمز و گوگل آلفابت را به دلیل عدم ثبت دفتر مرکزی خود در این کشور جریمه خواهد کرد. وزارت دادگستری ژاپن در آن زمان درخواست خود را مبنی بر اینکه چندین شرکت رسانه اجتماعی دفتر مرکزی جهانی خود را در ژاپن تا ۱۳ ژوئن ثبت کنند، اعلام کرد و هشدار داد که اگر شرکتها هنوز قصد ثبت نداشته باشند، از دادگاه درخواست جریمه خواهند کرد. مقررات شرکتهای ژاپنی، شرکتهای خارجی که به طور مداوم در این کشور فعالیت تجاری دارند را ملزم به ثبت دفتر مرکزی خود در ژاپن میکند.

همچنین در اکتبر ۲۰۲۴، شرکت متا در ژاپن با دعاوی جدیدی به دلیل تبلیغاتی که در فیسبوک و اینستاگرام حمایتهای جعلی افراد مشهور را همراه داشت و از این طریق جذب سرمایهگذاری میکردند، روبه رو شد و ۳۰ شاکی در مجموع ۴۳۵ میلیون ین (۲.۸ میلیون دلار) غرامت درخواست کردند.

شاکیان این پرونده معتقد بودند متا موظف است محتوای تبلیغات را بررسی کند و در صورت جعلی بودن، اجازه انتشار آنها را در رسانههای اجتماعی ندهد. اوایل سال ۲۰۲۴ نیز گروهی متشکل از چهار نفر، شکایتی مشابهی از متا در شهر کوبه ژاپن ثبت کرده بودند.

در ژوئیه ۲۰۲۲، ژاپن توهین در فضای مجازی را ممنوع کرد که مجازات آن تا یک سال حبس است. مقامات ژاپنی پس از خودکشی هانا کیمورا، ستاره تلویزیون که مورد سوء استفاده آنلاین قرار گرفته بود، اقدام به قانونگذاری در این زمینه کردند. برخی تحقیقات در ژاپن نشان میداد که رابطه مستقیمی بین خودکشی و آزارهای اینترنتی وجود دارد.